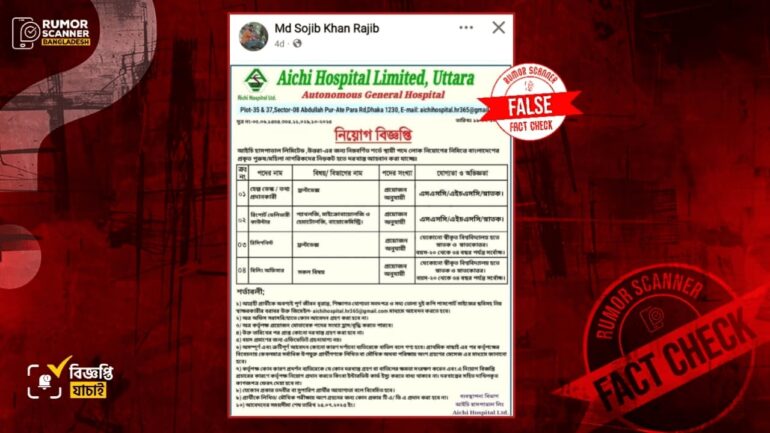

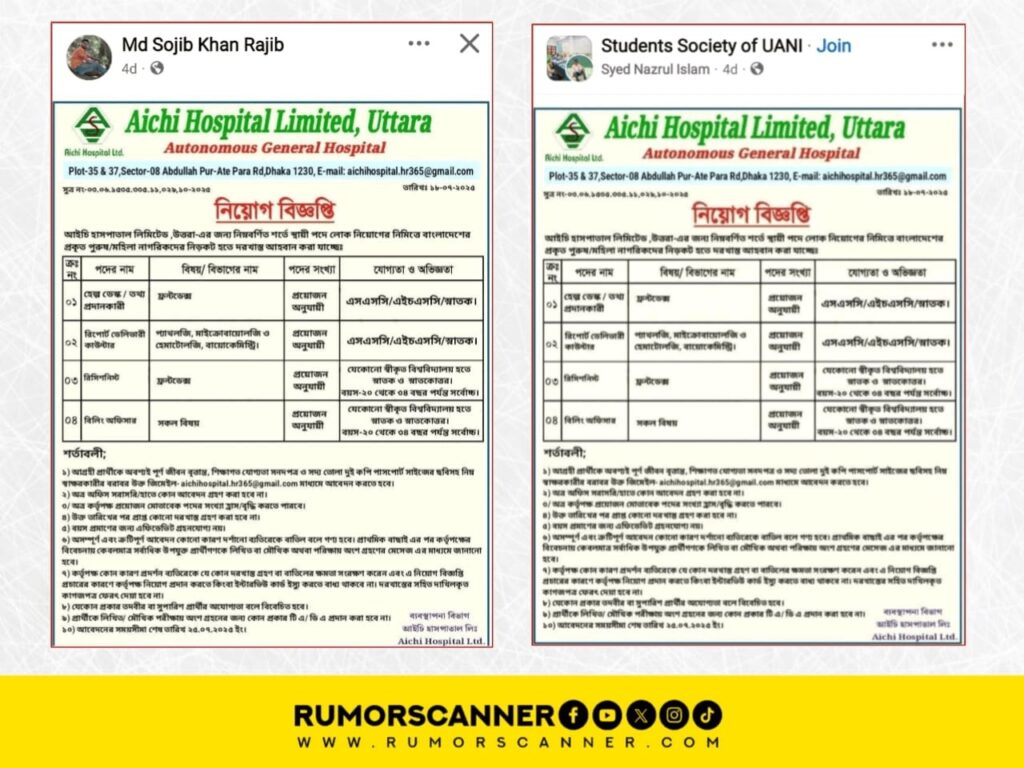

সম্প্রতি, “উত্তরার আইচি হাসপাতালে নিয়োগ” দাবিতে আইচি হাসপাতালের লোগো যুক্ত একটি নিয়োগ বিজ্ঞপ্তির ছবি সামাজিক যোগাযোগ মাধ্যম ফেসবুকে প্রচার করা হয়েছে।

প্রচারিত নিয়োগ বিজ্ঞপ্তিটির শর্তাবলীতে উল্লেখ করা হয়,

১. আগ্রহী প্রার্থীকে অবশ্যই পূর্ণ জীবন বৃত্তান্ত, শিক্ষাগত যোগ্যতা সনদপত্র ও সদ্য তোলা দুই কপি পাসপোর্ট সাইজের ছবিসহ নিম্ন স্বাক্ষরকারীর বরাবর উক্ত জিমেইল- [email protected] মাধ্যমে আবেদন করতে হবে।

২. অত্র অফিস সরাসরি/হাতে কোন আবেদন গ্রহণ করা হবে না।

৩. অত্র কর্তৃপক্ষ প্রয়োজন মোতাবেক পদের সংখ্যা হ্রাস/বৃদ্ধি করতে পারবে।

৪. উক্ত তারিখের পর প্রাপ্ত কোনো দরখাস্ত গ্রহণ করা হবে না।

৫. বয়স প্রমাণের জন্য এফিডেভিট গ্রহনযোগ্য নয়।

৬. অসম্পূর্ণ এবং ক্রটিপূর্ণ আবেদন কোনো কারণ দর্শানো ব্যতিরেকে বাতিল বলে গণ্য হবে। প্রাথমিক বাছাই এর পর কর্তৃপক্ষের বিবেচনায় কেবলমাত্র সর্বাধিক উপযুক্ত প্রার্থীগণকে লিখিত বা মৌখিক অথবা পরিক্ষায় অংশ গ্রহণের মেসেজ এর মাধ্যমে জানানো হবে।

৭. কর্তৃপক্ষ কোন কারণ প্রদর্শন ব্যতিরেকে যে কোন দরখাস্ত গ্রহণ বা বাতিলের ক্ষমতা সংরক্ষণ করেন এবং এ নিয়োগ বিজ্ঞপ্তি প্রচারের কারণে কর্তৃপক্ষ নিয়োগ প্রদান করতে কিংবা ইন্টারভিউ কার্ড ইস্যু করতে বাধ্য থাকবে না। দরখাস্তের সহিত দাখিলকৃত কাগজপত্র ফেরৎ দেয়া হবে না।

৮. যেকোন প্রকার তদবীর বা সুপারিশ প্রার্থীর অযোগ্যতা বলে বিবেচিত হবে।

৯. প্রার্থীকে লিখিত/ মৌখিক পরীক্ষায় অংশ গ্রহনের জন্য কোন প্রকার টি এ/ ডি এ প্রদান করা হবে না।

১০. আবেদনের সময়সীমা শেষ তারিখ ২৫.০৭.২০২৫ ইং।

উক্ত দাবিতে ফেসবুকে প্রচারিত পোস্ট দেখুন এখানে (আর্কাইভ) এবং এখানে (আর্কাইভ)।

ফ্যাক্টচেক

রিউমর স্ক্যানার টিমের অনুসন্ধানে জানা যায়, উত্তরার আইচি হাসপাতালের নামে প্রচারিত নিয়োগ বিজ্ঞপ্তিটি আইচি হাসপাতাল কর্তৃপক্ষ প্রকাশ করেনি বরং, আর্থিক প্রতারণার উদ্দেশ্যে কথিত এই নিয়োগ বিজ্ঞপ্তিটি আইচি হাসপাতালের নাম ব্যবহার করে প্রচার করা হয়েছে।

এই বিষয়ে অনুসন্ধানের শুরুতেই কথিত নিয়োগ বিজ্ঞপ্তির ছবিটি পর্যালোচনা করে দেখা যায়, নিয়োগ বিজ্ঞপ্তিটি প্রকাশের সময় হিসেবে ১৮ জুলাই, ২০২৫ উল্লেখ রয়েছে এবং ছবির উপরে ‘Aichi Hospital’ এর লোগো এবং নাম যুক্ত আছে।

পরবর্তীতে, আইচি হাসপাতালের ওয়েবসাইট এবং সামাজিক যোগাযোগ মাধ্যমগুলো পর্যবেক্ষণ করে আলোচিত নিয়োগ বিজ্ঞপ্তির কোনো সত্যতা পাওয়া যায়নি।

তবে, ‘Aichi Hospital Ltd’ এর ফেসবুক পেজে গত ২৮ জুলাই আলোচিত নিয়োগ বিজ্ঞপ্তিটি সম্পূর্ণ ভিত্তিহীন এবং ভুয়া জানিয়ে একটি সতর্কবাণী পোস্ট করা হয়। উক্ত পোস্টে আইচি হসপিটাল কর্তৃপক্ষ এ ধরনের কোন নিয়োগ বিজ্ঞপ্তি প্রকাশ করেনি বলে জানিয়ে এ ধরনের ভুয়া নিয়োগ বিজ্ঞপ্তির ফাঁদে পা না দেয়ারও অনুরোধ জানায়।

অর্থাৎ, প্রচারিত নিয়োগ বিজ্ঞপ্তিটি আইচি হাসপাতালের নয়।

সুতরাং, আইচি হাসপাতালের নামে প্রচারিত এই নিয়োগ বিজ্ঞপ্তিটি ভুয়া ও বানোয়াট।

তথ্যসূত্র

- Aichi Hospital Ltd: Facebook Post

- Rumor Scanner’s analysis